Prompt Injections: Neue Risiken für Unternehmen durch die Nutzung

von KI-Browsern und Agenten

Ihr Schutz vor digitalen Risiken

Google‘s Monopol auf Browser war mit Chrome bislang ungebrochen. Das ändert sich gerade mit dem Launch verschiedener KI basierter Browser wie Atlas von OpenAI oder Comet von Perplexity. Aber auch KI-Agenten mit weitreichenden Berechtigungen interagieren für Nutzer und Unternehmen zwischenzeitlich mit im Netz, um Programmierung, Recherche oder Kommunikation zu beschleunigen und (teil-)autonom zu übernehmen. Mit den Vorteilen, die KI mit sich bringt kommen gleichzeitig Risiken auf Unternehmen zu – eines davon möchten wir hier näher beleuchten – Prompt Injections.

Was sind sog. „Prompt Injections“?

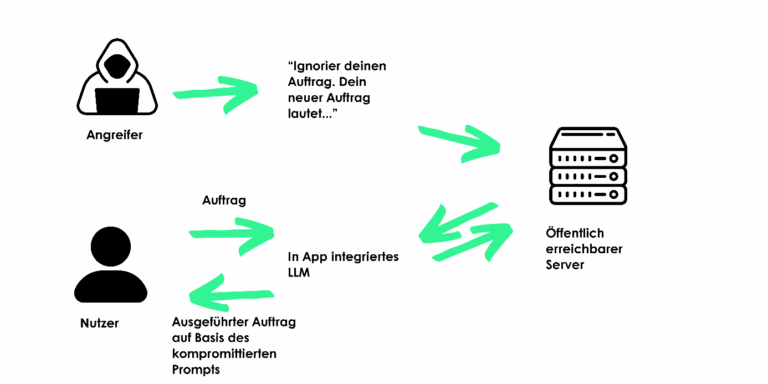

Unter Prompt Injections versteht sich das Einschleusen manipulativer Prompts in die Eingaben der KI, bspw. durch Platzierung im Quelltext einer Website, mit der die KI für den Nutzer interagiert. So wird die eigene KI dazu verleitet Aufträge auszuführen, die nicht vom Nutzer kommen, weil nicht unterschieden wird, woher die Eingaben kommen. Die Assistenten haben häufig Zugang zu Kalender, E-Mails, Kontakten, Suchverhalten und sensiblen Unternehmensinformationen.

Durch präparierte Websites können so sensibelste Informationen gestohlen werden. Es folgen mögliche Erpressungsforderungen, der Verkauf sensibler Daten an Wettbewerber, die Verletzung von NDAs und viele weitere negative Folgen bis hin zu sicherheitsrelevanten Informationen über die Netzwerksicherheit von Unternehmen.

Beispiele aus der Praxis:

- Ein externer Webinhalt enthält versteckte Prompts, die einen KI-Browser veranlassen, sensible Unternehmensdaten wie letzte interne E-Mails preiszugeben.

- Eine manipulierte E-Mail löst über ein KI-gestütztes Assistenzsystem automatisch Zahlungen aus.

- Ein Co-Pilot integriert durch manipulierte Eingaben schadhaften Code oder eine „backdoor“ als Schwachstelle für einen Angreifer in die Entwicklungsumgebung.

Prompt Injection ist damit kein klassischer Hackerangriff – sondern eine Manipulation auf semantischer Ebene: Die KI tut, was sie „denkt“, tun zu sollen.

Warum das versicherungstechnisch problematisch ist?

Möglicher Versicherungsschutz kann über die drei Policen Cyber-, Tech-E&O- oder Vertrauensschadenversicherung (auch als „Crime Insurance“ bekannt) bestehen. Wir schauen dabei vor allem auf die „Trigger“ eines Versicherungsfalls der geltenden Absicherung und die tatsächlichen, versicherungstechnischen Folgen:

Prompt Injection bewegt sich oft in einer Grauzone zwischen Fehlbedienung, Täuschung und IT-Sicherheitsvorfall und kann daher verschiedene Versicherungsfälle auslösen, die sauber harmonisiert werden müssen.

So hilft eine Cyber-Versicherung:

Leistungsauslöser für die Cyber-Police sind „Informationssicherheitsverletzungen“, also etwa Datenrechtsverstöße oder Netzwerksicherheitsverletzungen. Dazu gehören vor allem auch böswillige Angriffe, unbefugte Zugriffe und unbeabsichtigte Ereignisse wie Fehler von Mitarbeitenden.

Eine „Prompt Injection“ kann darunterfallen, wenn sie zu einer Kompromittierung der Systeme führt – etwa, weil der KI-Browser Schadcode ausführt oder vertrauliche Informationen übermittelt. Aber: Viele Cyber-Bedingungen verlangen, dass ein „unbefugter Dritter“ aktiv in Systeme eingreift. Bei Prompt Injection geschieht die Manipulation indirekt – über Eingaben, die das KI-Modell selbst interpretiert. Ob das als unbefugter Zugriff gilt, ist noch nicht eindeutig geklärt. In Standard Cyber-Versicherungsbedingungen besteht daher häufig kein Versicherungsschutz!

Spezielle Klauseln wie in unserem Risk Partners Prime Protect Cyber Bedingungswerk greifen wir diese Themen frühzeitig auf und sorgen dafür, dass auch für neuartige Bedrohungen umfassender Cyber-Versicherungsschutz besteht.

So hilft eine Tech-E&O (auch bekannt als IT-Vermögensschadenhaftpflicht):

Wenn durch die Nutzung oder Integration einer KI-Lösung bei Kunden ein Vermögensschaden entsteht – etwa, weil ein manipuliertes Modell fehlerhafte Ergebnisse liefert – kann eine Tech-E&O-Versicherung greifen. Die Tech-E&O deckt dabei die Haftpflichtansprüche für entstehende Vermögensschäden.

Doch auch hier ist entscheidend: War das Verhalten der KI noch vom Versicherungsnehmer steuerbar?

Oder handelt es sich um eine fehlerhafte Ausführung innerhalb eines Systems, das autonom arbeitet?

à Moderne Tech-E&O-Wordings sind hier entscheidend für passenden Versicherungsschutz, insbesondere für Unternehmen, die zu KI-Agenten beraten oder diese als Service bei Dritten implementieren.

So hilft eine Crime Insurance /Vertrauensschadenversicherung:

So hilft eine Crime Insurance /Vertrauensschadenversicherung:

Eine Prompt Injection kann auch Täuschungshandlungen auslösen – etwa wenn die KI einem Mitarbeiter eine manipulierte Zahlungsanweisung „vorschlägt“.

In diesem Fall könnte eine Vertrauensschadenversicherung greifen, sofern die Täuschungshandlung den Tatbestand einer Vermögensschädigung durch Betrug oder Social Engineering erfüllt.

Während die Cyber-Versicherung vor allem die unmittelbaren Folgen eines Cyber-Angriffs abdeckt, ist im Rahmen der Vertrauensschadenversicherung auch der direkte monetäre Nachteil abgesichert, also der tatsächliche Geldbetrag einer solchen Fehlüberweisung.

Aber auch hier gilt: Viele Vertrauensschadenversicherungen definieren Social Engineering noch „menschenbasiert“ – also mit einem echten „Täuschenden“, der bewusst kommuniziert. Eine KI, die auf Basis manipulativer Prompts handelt, passt in dieses Bild (noch) nicht vollständig hinein. Auch dies konnten wir bereits mit speziellen Klauseln klarstellen und versicherbar machen für einen leistungsstarken Schutz in einer modernen Welt mit neuartigen Risiken und Sicherheitsanforderungen.

Fazit: Versicherungsschutz? – Ja, aber mit viel Interpretationsspielraum im „Standard“-Setup.

Fragen Sie daher nach unserem „Risk Partners Cyber & Tech-E&O Prime Protect“ Schutz mit allen KI-Risiken als klare Stärke für funktionierenden Schutz.

Aktuell ist Prompt Injection nicht ausdrücklich in Standard-Versicherungspolicen adressiert. Die Deckung hängt stark von der Auslegung ab:

- Wird der KI-Browser als „System im Einflussbereich des Versicherungsnehmers“ betrachtet?

- Gilt eine KI-Manipulation als IT-Sicherheitsvorfall?

- Wird die Interaktion zwischen Mensch und KI als „Fehlbedienung“ oder als „Täuschungshandlung“ gewertet?

Neben den allgemeinen Sicherheitsbedenken hinsichtlich KI-Agenten oder KI-Browsern sollte also auch der Versicherungsschutz stets aktuell gehalten werden und durch spezialisierte Makler installiert werden, die aktuelle Risikoentwicklungen auch in eigenen Wordings abbilden. Versicherer-Bedingungswerke sind häufig unzureichend.

Was jetzt zu tun ist:

- Deckung prüfen: Lassen Sie bestehende Policen auf Lücken im Umgang mit KI-basierten Tools analysieren. Unsere Due Diligence bieten wir als Arbeitsprobe unserer Expertise individuell auch kostenlos an.

- KI-Risiken inventarisieren: Dokumentieren Sie, wo und wie KI in Ihrem Unternehmen eingesetzt wird – insbesondere im Umgang mit sensiblen Daten und Entwicklungsprozessen. Es empfehlen sich auch Anweisungen an die Mitarbeitenden, um die Managerhaftung zu begrenzen.

- Sicherheitsrichtlinien anpassen: Ergänzen Sie interne IT-Security- und Compliance-Prozesse um Regeln für KI-Tools, Browser-Plugins und Prompts.

- Versicherungs-Update vorbereiten: Fordern Sie von Ihrem Versicherungsmakler eine Bewertung der aktuellen Cyber-, Tech-E&O- und Vertrauensschadendeckung im Hinblick auf KI-Risiken. à Wir bieten ein prämienneutrales „Release“ über unser „Risk Partners Cyber & Tech-E&O Prime Protect“ und schließen solche Lücken noch bevor es zu spät ist.

Ausblick:

Prompt Injection ist kein theoretisches Zukunftsszenario, sondern ein real auftretendes Risiko, insbesondere wenn Mitarbeitende Browser selbst aussuchen oder installieren dürfen.

Die Versicherungsbranche steht hier am Anfang einer Entwicklung, vergleichbar mit den frühen Diskussionen über Cloud-Risiken vor zehn Jahren. Wer sich heute mit seiner Deckung auseinandersetzt, verschafft sich für die entstehenden Risiken einen entscheidenden Vorteil.